Künstliche Intelligenz – kaum ein Thema wird aktuell so kontrovers diskutiert. Die einen sehen in ihr die nächste industrielle Revolution. Die KI werde – so heißt es – die Verrichtungen des alltäglichen Lebens vereinfachen oder automatisieren und komplexe Entwicklungen wie die des Gesundheitswesens oder von Institutionen wie der öffentlichen Verwaltung perfektionieren. Auf der anderen Seite stehen die Kritiker. Sie bangen um ihre Arbeitsplätze. Und sie befürchten den Verlust der menschlichen Selbstbestimmung durch die Herrschaft einer omnipräsenten Künstlichen Intelligenz.

Bild: Sabine Mittermeier/mit Zuhilfenahme von KI

Auch wenn die Technologie brandneu wirkt: Die Frage, ob Maschinen denken können, beschäftigt Menschen schon seit Jahrhunderten. Bereits 1950 entwickelte der Informatiker Alan Turing einen Test, der prüfen sollte, ob eine Maschine menschliche Intelligenz simulieren kann. Mit dem Siegeszug des Computers nahm die Entwicklung weiter Fahrt auf. In unserem Alltag ist KI bereits seit Jahren präsent, etwa in Form virtueller Assistenten wie Amazons Alexa oder Apples Siri.

Maschinelles Lernen (ML) ist ein wesentlicher Bestandteil von KI. Dabei werden Algorithmen so trainiert, dass sie Muster und Zusammenhänge in großen Datensätzen finden. Auf diese Weise „lernen“ Computer aus Daten – und werden dadurch immer intelligenter. Eine Untergruppe des ML sind die sogenannten Large Language Models oder LLMs, zu Deutsch: große Sprachmodelle. Ihr Zweck: Menschliche Sprache zu verstehen, zu verarbeiten und zu generieren. LLMs gehören zur so genannten generativen KI, die neue Inhalte erstellt. 2022 veröffentlichte der US-Softwareentwickler OpenAI das LLM ChatGPT, das seitdem den Markt dominiert und dass einem größeren Teil der Bevölkerung dadurch ins Bewusstsein rückte, dass deren Kinder sich ihre Schularbeiten mit dem KI-Programm unerlaubterweise erleichterten.

Auch ein Drittel der Älteren nutzt KI

Beim Nutzerverhalten zeigen sich denn auch – wenig verwunderlich – starke Unterschiede zwischen den Altersgruppen: je jünger, desto KI-affiner. Mehr als 90 Prozent der jungen Menschen zwischen 16 und 29 gaben in einer Studie des TÜV-Verbandes 2025 an, KI zu nutzen. Bei den Über-65-Jährigen waren es 35 Prozent, durch alle Altersgruppen hindurch sind es 65 Prozent. Am häufigsten wird ChatGPT konsultiert, gefolgt von Google Gemini und Copilot von Microsoft. Die Anwendungen werden vor allem zu Recherchezwecken eingesetzt, aber auch zur Ideenfindung und zum Übersetzen. Etwas rückläufig ist der Einsatz von KI, um Texte zu verfassen oder zu verbessern.

Bild: KI-genereriert

Immer häufiger werden Chatbots auch als Lebenshilfe genutzt, etwa bei psychischen Problemen. In speziellen Apps wie Blush oder Replika lassen sich „beste virtuelle AI-Freunde“ bauen, die auch als Partner:innen-Ersatz fungieren. In den USA klagen mehrere Familien gegen die App Character.AI, weil sie sie für mitverantwortlich am Suizid ihrer minderjährigen Kinder halten. KI verändert auch das Nutzerverhalten in Suchmaschinen: Es wird weniger auf Links geklickt, Nachrichtenseiten verlieren Leser:innen – stattdessen kommt den KI-Zusammenfassungen zunehmend größere Bedeutung zu. Selbst, wenn man KI nicht aktiv nutzt, kann man ihr kaum entgehen: Sie ist bereits – mehr oder weniger sichtbar – überall in unserem Alltag integriert, ob beim Spamfilter des Mailpostfachs, in Navigations-Apps oder bei der Gesichtserkennung am Flughafen.

Unbestritten ist, dass die Künstliche Intelligenz große Veränderungen mit sich bringt, gerade für die Arbeitswelt. Jobs, die sich leicht automatisieren lassen, könnten künftig von der KI übernommen werden – und zwar nicht nur in der Industrie, sondern „zunehmend auch in klassischen Bürojobs“, wie die Tagesschau berichtet. Klar sein muss auch: „KI-Systeme können immer nur so gut sein wie die zum Training benutzten Daten“, so das Bundesamt für Sicherheit in der Informationstechnik (BSI). Darin steckt eine wesentliche Schwierigkeit von KI: Häufig sind die Daten, mit denen KI-Systeme trainiert werden, fehlerhaft, unvollständig – oder auch einseitig oder gar diskriminierend. So konnten Studien nachweisen, dass für das Training von KI häufig nutzergenerierter Inhalt – wie von der Community-Plattform Reddit oder von Wikipedia – eingesetzt wird. Ein KI-Bias, also eine Verzerrung, entsteht beispielsweise dadurch, dass veraltete Daten genutzt werden – und dadurch zum Beispiel inzwischen überkommene Rollenbilder reproduziert werden („Führungskräfte sind männlich“).

Foto: Sabine Mittermeier

Ein weiteres großes Problem sind die sogenannten Halluzinationen, also KI-generierte Inhalte, die möglicherweise plausibel erscheinen, es aber nicht sind. Ein Grund dafür: Die KI erfindet lieber Fakten, als einzugestehen, dass sie die Antwort nicht weiß. Einer aktuellen Studie der Europäischen Rundfunkunion (EBU) zufolge erfinden Chatbots bis zu 40 Prozent ihrer Antworten und präsentieren sie als Fakten, teilweise sogar mit erfundenen Quellen. Deswegen empfiehlt es sich dringend, KI-generierte Informationen immer einem Faktencheck zu unterziehen. Ein weiteres Risiko: Mit KI lassen sich schnelle und umfassende Desinformations-Kampagnen starten, sprich „Fake News“ in Umlauf bringen. KI-generierte Texte, die wie echte Nachrichtenbeiträge wirken, oder Deep Fakes – täuschend echte, aber gefälschte Bilder oder Videos – können binnen kürzester Zeit über Fake-Accounts und Bots im Netz verteilt werden. Jüngst geriet Elon Musks KI-Tool Grok in die Schlagzeilen, weil Nutzer:innen damit in Sekundenschnelle sexualisierte KI-Bilder von echten Menschen erstellen konnten.

Auch ethische Bedenken werden immer wieder im Zusammenhang mit KI laut, etwa im Bereich Datenschutz oder mangelnder Transparenz der Daten. Ein Beispiel: Facebook nutzt seit 2025 öffentlich zugängliche Userdaten, um seine eigene KI zu trainieren. Italien hatte 2023 ChatGPT wegen datenschutzrechtlicher Bedenken kurzzeitig verboten.

Die dunkle Seite der Technologie

Schließlich wird KI auch mit negativen Umweltauswirkungen in Verbindung gebracht. Greenpeace hat 2025 einen Bericht veröffentlicht, der zu dem Ergebnis kommt, dass Strom- und Wasserverbrauch durch die steigende Rechenleistung und die zu kühlenden Rechenzentren künftig stark ansteigen werden.

Foto: pa/SZ Photo

Auch auf dem Wohnungsmarkt spielt KI eine ambivalente Rolle. Sie kann Mietenden neue Möglichkeiten eröffnen, birgt aber auch Gefahren. So bieten sich Immobilienverwaltungen neue Wege, potenzielle Neumieter:innen zu „durchleuchten“: Beim so genannten Tenant Screening werden KI-Anwendungen genutzt, um die bisherige Miethistorie, Kreditwürdigkeit oder Jobstatus zu überprüfen. Hier droht die Gefahr von Diskriminierung etwa aufgrund eines geringeren Einkommens, des Alters oder der Herkunft. Das Allgemeine Gleichbehandlungsgesetz verbietet zwar die Diskriminierung bei der Wohnungssuche und im Mietverhältnis. Häufig ist eine solche aber nur schwer nachweisbar. KI könnte Transparenzmangel und rechtliche Grauzonen bei der Wohnungsvergabe noch vergrößern.

Problematisch können auch vermeintlich „smarte“ Helfer in der Wohnung sein: Thermostate, Türschlösser oder Bewegungsmelder. Häufig übermitteln die Geräte sensible Daten nicht verschlüsselt oder speichern diese nicht ausreichend gesichert, was Cyberkriminellen leichtes Spiel gibt. Diese Gefahren dürften sich durch KI noch verstärken. In San Francisco hat eine NGO Ende 2025 dagegen geklagt, dass Vermieter:innen ihren Mietenden Smart-Home-Lösungen aufgezwungen hatten, die via KI auch Profile über das jeweilige Nutzerverhalten anlegen konnten. Die Gefahren – vom Datenschutz mal ganz abgesehen: Die Daten eröffnen eine Handhabe gegen „teure“ oder „unleidige“ Mieter:innen.

Eine neue Chance für schnellere Kommunikation

Wohnungseigentümer:innen nutzen KI auch, um die Höhe ihrer Mietpreise zu kalkulieren. Immoscout24 schreibt dazu: „(…) Es war noch nie so einfach, die Miethöhe richtig einzuordnen“, und verweist auf ChatGPT. Spielräume werden so komplett ausgeschöpft, was zu höheren Mieten führen kann. In den USA, wo der Mietpreis durch einen Algorithmus bestimmt wird, haben Mietende 2022 gegen eine große Immobiliensoftware-Firma geklagt. Der Grund: Sie treibe die Preise künstlich in die Höhe.

Foto: pa/Westend61

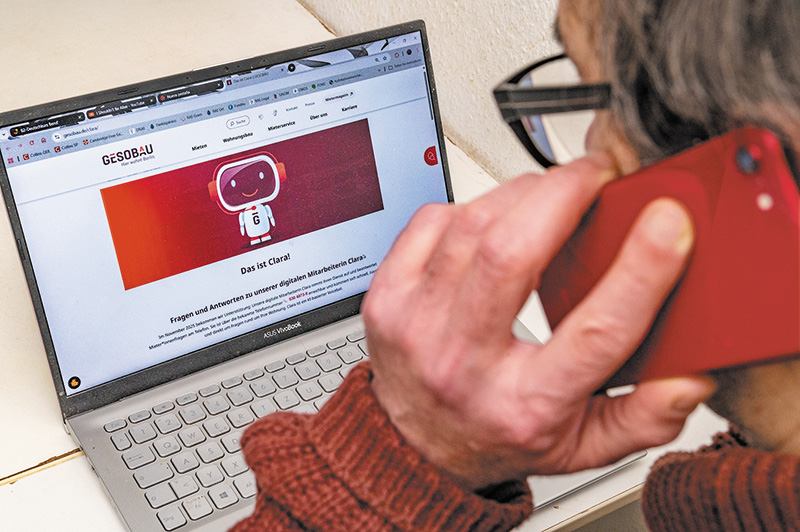

Automatisierte Verwaltungsprozesse können aber auch Vorteile für Mieterinnen und Mieter haben. So beschleunigen etwa KI-Chatbots im Auftrag von Immobilienverwaltungen häufig die Kommunikation. Die Gewobag hat Mitte 2025 den Chatbot GewobagGPT vorgestellt, der allerdings nur Mitarbeitenden zur Verfügung steht. Einen Schritt weiter gehen die WBM (Wohnungsbaugesellschaft Berlin-Mitte mbH) mit der „mehrsprachigen, elektronischen Chatpartnerin“ Mia Mittendrin und die Gesobau mit dem KI-basierten Voicebot Clara, der Telefonate führen kann. Einen Chatbot für Mieter:innen stellt auch Heimstaden zur Verfügung. Das Ziel der neuen Angebote: Anliegen effizienter und schneller, etwa auch für Nicht-Muttersprachler und außerhalb der Öffnungszeiten des Kundendienstes zu bearbeiten und Mitarbeitende zu entlasten. Klar ist aber auch: Bei komplexeren Fällen müssen immer noch Menschen ran.

Foto: Sabine Mittermeier

Hilfreich sein kann KI auch im Bereich „Predictive Maintenance“, was so viel heißt wie „vorausschauende Instandhaltung“. Ziel ist es, Wartungserfordernisse rechtzeitig zu erkennen – mithilfe von Sensoren und KI. Eine Heizung wird dann nicht erst repariert, wenn sie defekt ist, sondern bereits im Vorfeld – ein klarer Vorteil (auch) für Mietende. Das Mängelmanagement kann sich für Mietende ebenfalls vereinfachen, wenn entsprechende KI-Anwendungen Bilder von Schäden in der Wohnung auswerten.

KI kann Kommunen bei der Bewältigung großer Datenmengen helfen, was wiederum Vorteile für die Bürger:innen hat. So will Friedrichshain-Kreuzberg der Flut an illegalen Ferienwohnungen mit sogenannten KI-Scraping-Programmen entgegenwirken, die automatisiert Angebote durchforsten (das MieterMagazin berichtete im Mai 2025). Die Senatsverwaltung für Stadtentwicklung, Bauen und Wohnen prüft den Einsatz von KI in der Bearbeitung von Wohngeldanträgen. Eine Software, mit der Anträge KI-gestützt auf Vollständigkeit geprüft werden, soll demnach in vier Bezirken getestet werden.

KI-Aussagen besser nachprüfen

ChatGPT und Co. können zudem dabei unterstützen, die eigenen Rechte als Mieter:in zu kennen und durchzusetzen. So lässt sich etwa die – in vielen Fällen fehlerhafte – Nebenkostenabrechnung mithilfe von KI leichter überprüfen (Achtung: unbedingt vorher alle sensiblen Daten schwärzen). Ob Mietverträge rechtens sind, wollen Seiten wie beglaubigt.de oder klauselcheck.com überprüfen können. KI kann dabei helfen, Briefe an Vermieter:in oder Hausverwaltung zu formulieren. Auch Mietrechtsfragen beantwortet die KI – sowohl die bekannten Plattformen als auch spezialisierte Angebote wie rechtspilot.de oder mietrecht.ai (das jedoch auf österreichischem Mietrecht basiert). Ganz wichtig: Zwar können diese Angebote einen guten ersten Überblick bieten. Doch nicht immer stimmen die Aussagen, weswegen eine Überprüfung unerlässlich ist. Sobald es etwas komplizierter wird, kommt man um eine fundierte Rechtsberatung etwa bei einem Mieterverband nicht herum, denn Mietrecht ist Einzelfallrecht.

Bild: KI-genereriert

Schließlich können neue, KI-basierte Anwendungen Mieter:innen das Leben erleichtern. Ein Berliner Startup möchte nicht weniger als „die Wohnungssuche revolutionieren“, indem es Informationen bündelt: keymatch.ai durchsucht nach eigenen Angaben täglich mehr als 2000 Immobilienportale, greift auf mehr als 1,5 Millionen Inserate zu und lässt Suchende dabei 90 Prozent der Zeit sparen.

Auch beim Designen hilft Künstliche Intelligenz: Wer die eigenen vier Wände umgestalten möchte, kann Bilder von den Räumen in ein KI-Tool laden und dazu prompten, was gewünscht wird: Sollen die Möbel anders gestellt werden, oder ist eine neue Wandfarbe angedacht? Mit den entsprechenden Hinweisen kann die Anwendung neue Layouts liefern.

Last but not least: Der sich durch die KI verändernde Arbeitsmarkt könnte auch direkte Auswirkungen auf den Mietmarkt haben. Die Berliner Morgenpost berichtete im Januar von Prognosen, dass Büroflächen durch den KI-bedingten Wegfall von Jobs weiter abgebaut werden könnten. Und beleuchtete die Möglichkeit, aus den ehemaligen Gewerbeflächen bezahlbaren Wohnraum zu machen.

Katharina Buri

Welche KI-Tools für welchen Zweck? Eine aktuelle Übersicht bietet:

www.ainauten.com/c/top-ki-tools-liste

Immobilienscout24 hat einen Ratgeber veröffentlicht, der erklärt, wie man die Nebenkostenabrechnung von ChatGPT prüfen lassen kann:

www.immobilienscout24.de/wissen/ki-wissen/nebenkostenabrechnung-ki.html

KI und Mietrecht: „Für eine erste Orientierung sinnvoll“

MieterMagazin: Welche Chancen bieten KI-Tools Mietenden aus Ihrer Sicht?

Sebastian Bartels: Mietende können sich besser und schneller als bisher im Internet zur Rechtslage orientieren, bevor sie unsere professionelle Beratung aufsuchen. Die KI ersetzt keine BMV-Beratung und -vertretung, gibt aber erste, oft präzise Hinweise und vermeidet, dass man einen falschen Weg einschlägt, sich zum Beispiel eine absurde Abmahnung zu Herzen nimmt.

Foto: Sabine Mittermeier

MieterMagazin: Welche Risiken gehen aus Sicht des BMV mit KI einher?

Sebastian Bartels: Ein großes Risiko liegt darin, dass Ratsuchende das Wissen von KI mit einer professionellen Beratung wie der des BMV gleichsetzen. Wir erleben zunehmend, dass Mitglieder von ihrer durch einen KI-Chat gewonnenen Ansicht nicht abrücken, wenn sie einer BMV-Beraterin gegenübersitzen. Es heißt dann oft: ‚KI sieht das aber anders‘. Niemand kann die Expertise eines professionellen Beraters ersetzen, denn der kann Argumente gegeneinander abwägen.

MieterMagazin: Was fordern Sie diesbezüglich von Politik und Vermieter:innen?

Sebastian Bartels: Kritisch sehen wir das potenzielle Durchleuchten von Mieter:innen mittels KI, etwa bei Wohnungsbewerbungen. Die Politik muss datenschutzrechtliche Grenzen für das Mietrecht und andere Vertragsarten ziehen.

MieterMagazin: Wie verändert sich die Arbeit des BMV durch die Nutzung von KI?

Sebastian Bartels: Wir sind dabei zu prüfen, durch professionellen Einsatz von KI im Vorfeld einer Anwaltsberatung unseren Mitgliedern erste Checks an die Hand zu geben. KI kann etwa Betriebs- und Heizkostenabrechnungen auf Rechenfehler oder grobe Auffälligkeiten scannen. Zudem wird derzeit von Aktiven ein KI-gestütztes Tool entwickelt, mit dem Hausgemeinschaften und Mieterinitiativen in großen Siedlungen sich übersichtlicher organisieren können. Da der BMV im Organizing engagiert ist, käme das auch unseren Mitgliedern zugute.

Interview: Katharina Buri

KI und Datenschutz: „Bislang häufig eine Blackbox“

MieterMagazin: Inwiefern haben sich die datenschutzrechtlichen Verstöße durch KI verändert?

Meike Kamp: Im Datenschutzrecht unterscheiden wir zwischen der Entwicklung und der Anwendung von KI-Systemen. In der Entwicklung stellen sich Fragen wie: Werden personenbezogene Daten beim Training des KI-Modells verwendet, und sind diese rechtmäßig erhoben worden? In der Anwendungsphase kommt es darauf an, wer das KI-Modell in welchen Szenarien betreibt und ob zum Beispiel die KI automatisierte Entscheidungen mit Rechtswirkungen trifft. Der Einsatz von KI bleibt bislang oftmals eine Blackbox. Aus meiner Sicht ist jedoch Transparenz zentral, um KI vertrauenswürdig zu machen.

Foto: Annette Koroll

MieterMagazin: Wo sehen Sie Mieterinnen und Mieter durch KI besonders gefährdet?

Meike Kamp: Aufgrund des KI-Hypes probieren gerade viele Unternehmen KI-Anwendungen aus, zum Beispiel für die Beantwortung von Kundenanfragen oder in Form eines Chatbots auf ihrer Website. Das betrifft auch Mieter:innen: Wir führen derzeit ein Verfahren gegen eine Berliner Immobilienplattform, die ein KI-Modell mit den Daten ihrer Kund:innen trainiert hat, ohne dies transparent zu machen. Das stellt einen Verstoß gegen die Datenschutzgesetze dar.

Interview: Katharina Buri

Und das meint die KI

Bild: KI-generiert

Wir haben ChatGPT gefragt, wie KI die Situation für Mietende verbessern kann. Die Antwort: „KI kann das Machtungleichgewicht zwischen Mietern und Vermietern reduzieren, wenn sie konsequent als Werkzeug für Transparenz, Rechte und Zugang zu Informationen eingesetzt wird.“ Dazu braucht es laut ChatGPT:

- strengen Datenschutz (DSGVO)

- transparente, überprüfbare Algorithmen

- öffentlich zugängliche, qualitativ gute Daten

- klare Regulierung, damit KI nicht primär Vermietern dient

Noch sind viele Bereiche, in denen KI schon zum Einsatz kommt, unzureichend reguliert. Dies gilt auch für den Mietmarkt. Hier sollte schnell nachgebessert werden, um Diskriminierung und mangelnde Transparenz zu beseitigen. All dies muss auf politischer Ebene angegangen werden. Die Politik könnte KI künftig auch nutzen, um Wohnungsmarktdaten auszuwerten und Leerstand und Zweckentfremdung entgegenzuwirken. Oder sie könnte die Auswirkungen von Gesetzen simulieren, etwa im Bereich Mietendeckel und Neubauförderung. Auf individueller Ebene macht es Sinn, sich mit der neuen Technologie vertraut zu machen, um gut damit umgehen zu können. Denn klar ist: Die KI wird nicht mehr verschwinden, sondern künftig noch deutlich stärker in unseren Alltag eingreifen als bisher.

kb

19.02.2026